MiniMax开源4M超长高下文新模子!性能并列DeepSeek-v3、GPT-4o

西风 发自 凹非寺

量子位 | 公众号 QbitAI

开源模子高下文窗口卷到超长,达400万token!

刚刚,“大模子六小强”之一MiniMax开源最新模子——

MiniMax-01系列,包含两个模子:基础话语模子MiniMax-Text-01、视觉多模态模子MiniMax-VL-01。

MiniMax-01初度大范围膨胀了新式Lightning Attention架构,替代了传统Transformer架构,使模子概况高效措置4M token高下文。

在基准测试中,MiniMax-01性能与顶级闭源模子进展畸形。

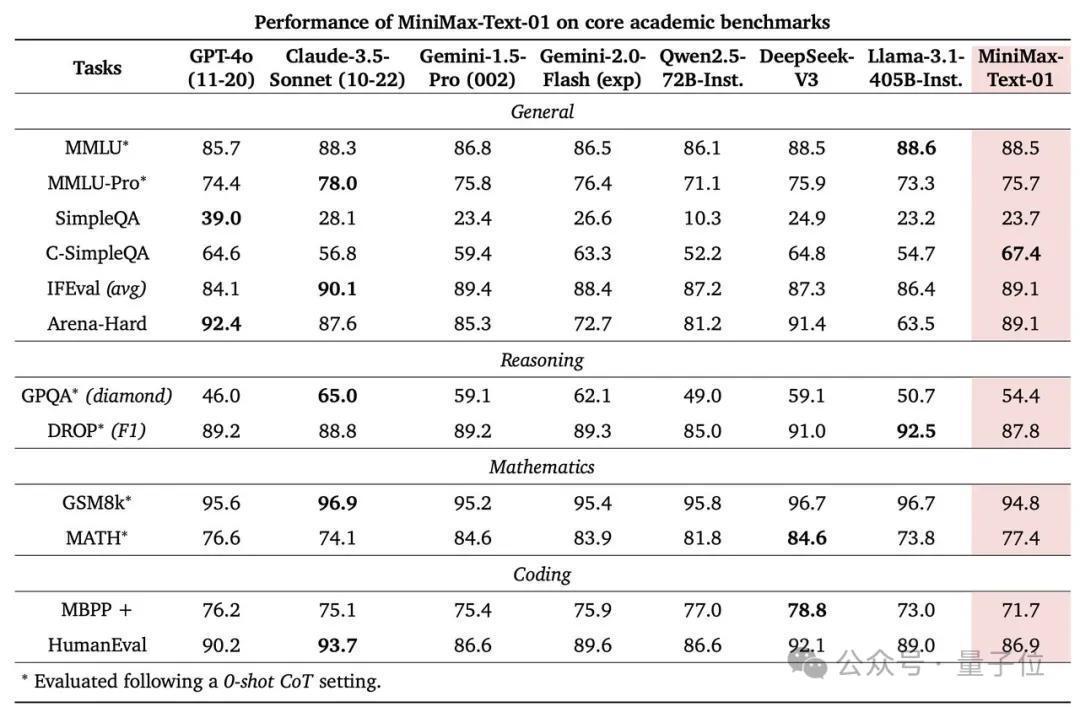

MiniMax-Text-01性能与前段时间大火的DeepSeek-V3、GPT-4o等打的有来有回:

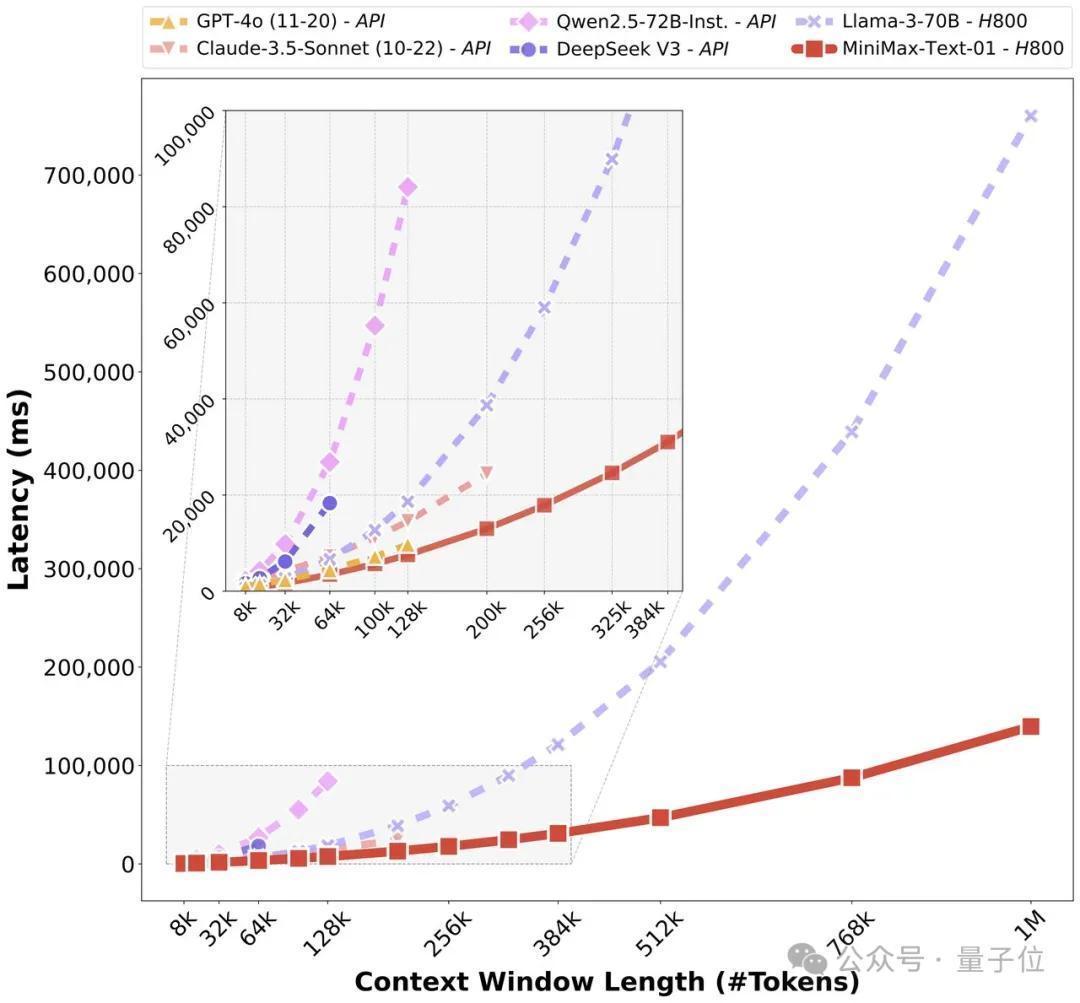

如下图(c)所示,当高下文跳跃20万token,MiniMax-Text-01的上风平静昭彰。

在预填充延伸方面也有显赫上风,在措置超长高下文时更高效,延伸更低:

网友直呼“难以置信”:

怒放权重,领有400万token的高下文窗口!我底本以为这可能要五年后才会终了。

官方默示,MiniMax-01是为解救之后Agent干系诈骗而野心的:

因为Agent越来越需要膨胀的高下文措置智商和执续的内存。

现在官方还公开了MiniMax-01的68页时刻论文,何况已将MiniMax-01在Hailuo AI上部署了,可免费试用。

另外,新模子API价钱也被打下来了:

输入每百万token0.2好意思元,输出每百万token1.1好意思元。

底下是模子更多细节。

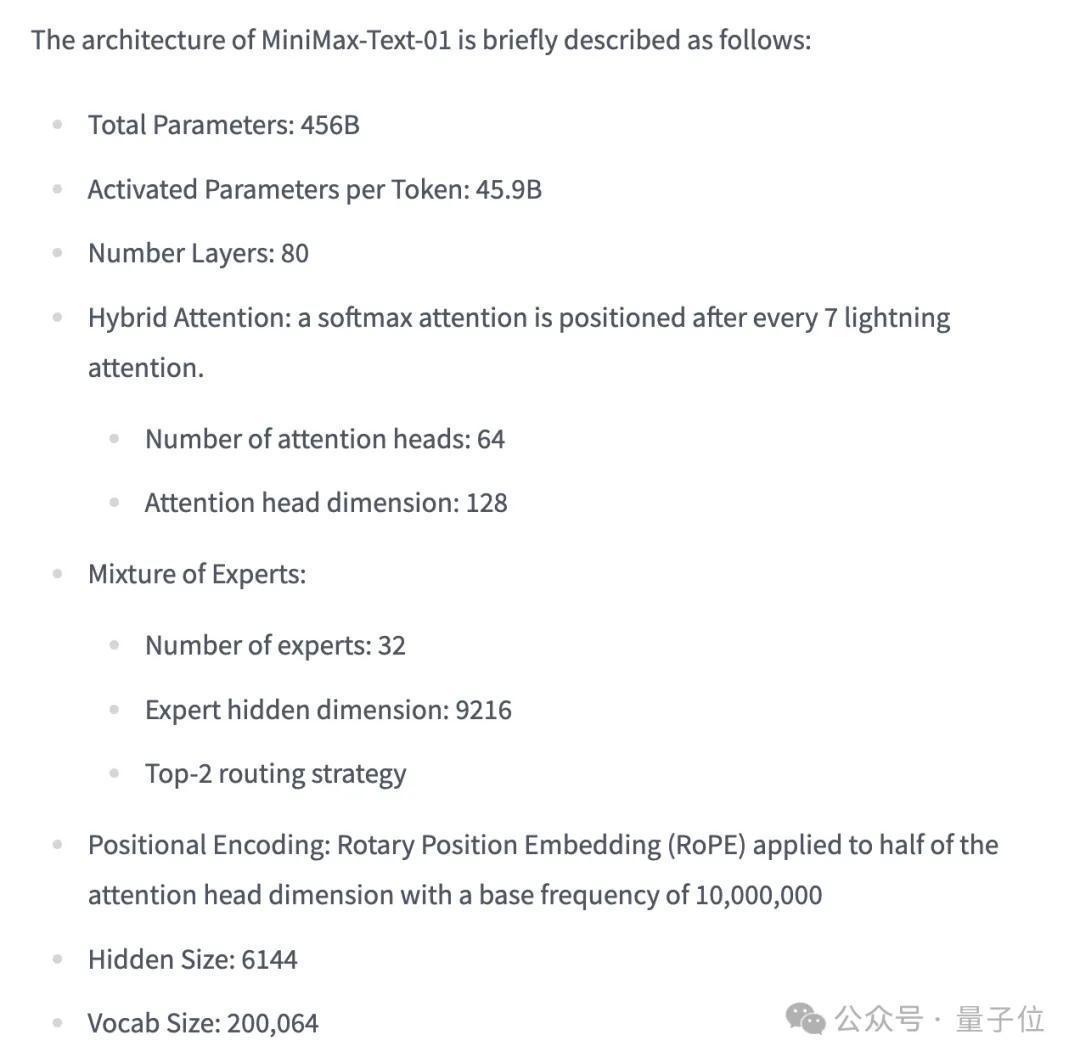

4M超长高下文MiniMax-Text-01MiniMax-Text-01,参数456B,每次推理激活45.9B。

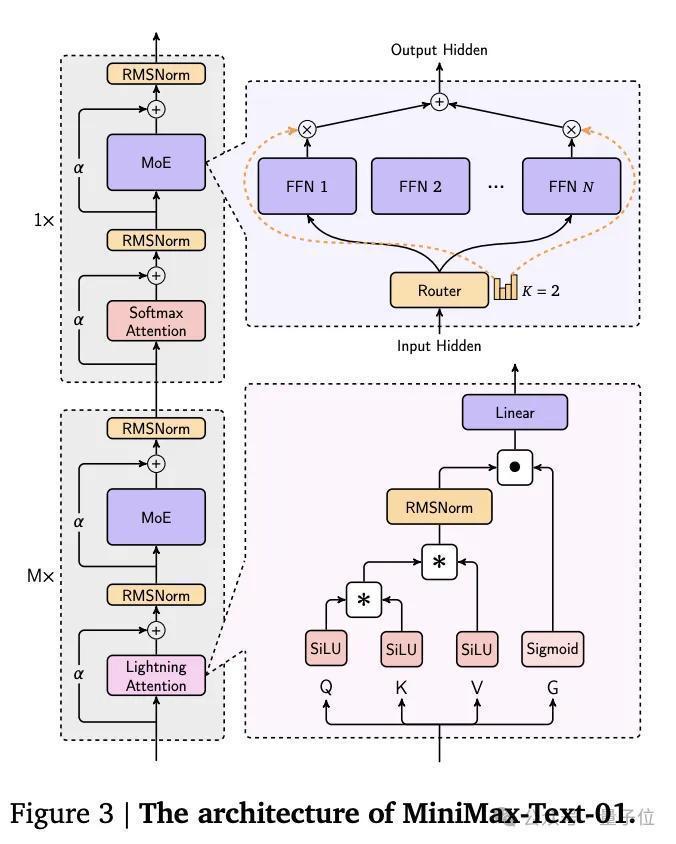

它革命性地罗致了羼杂架构,合股了Lightning Attention、Softmax Attention以及Mixture-of-Experts(MoE)。

何况通过LASP+、varlen ring attention、ETP等优化的并行战术和高效的臆想打算通讯一样次第,MiniMax-Text-01造就高下文长度达100万token,推理时不错膨胀到400万token高下文。

模子架构细节如下:

在Core Academic Benchmark上,MiniMax-Text-01在GPQA Diamond上获取54.4分,卓越GPT-4o。

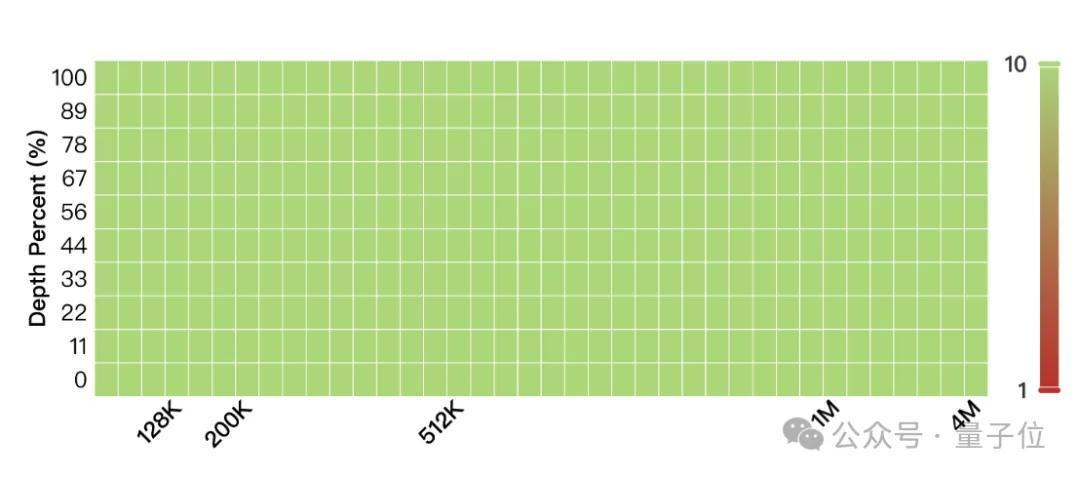

在长基准测试之4M大海捞针测试,MiniMax-Text-01一水儿全绿。

也便是说,这400万高下文里,有细节MiniMax-Text-01是真能100%捕捉到。

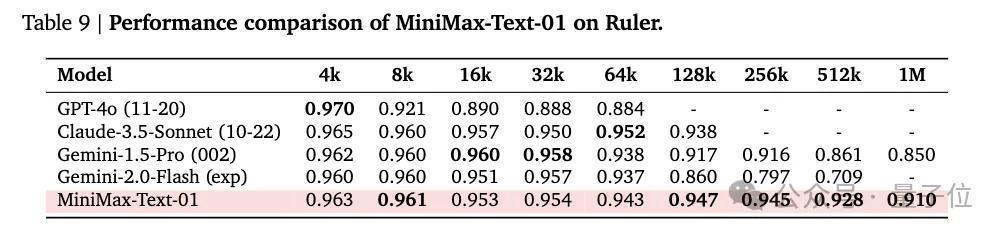

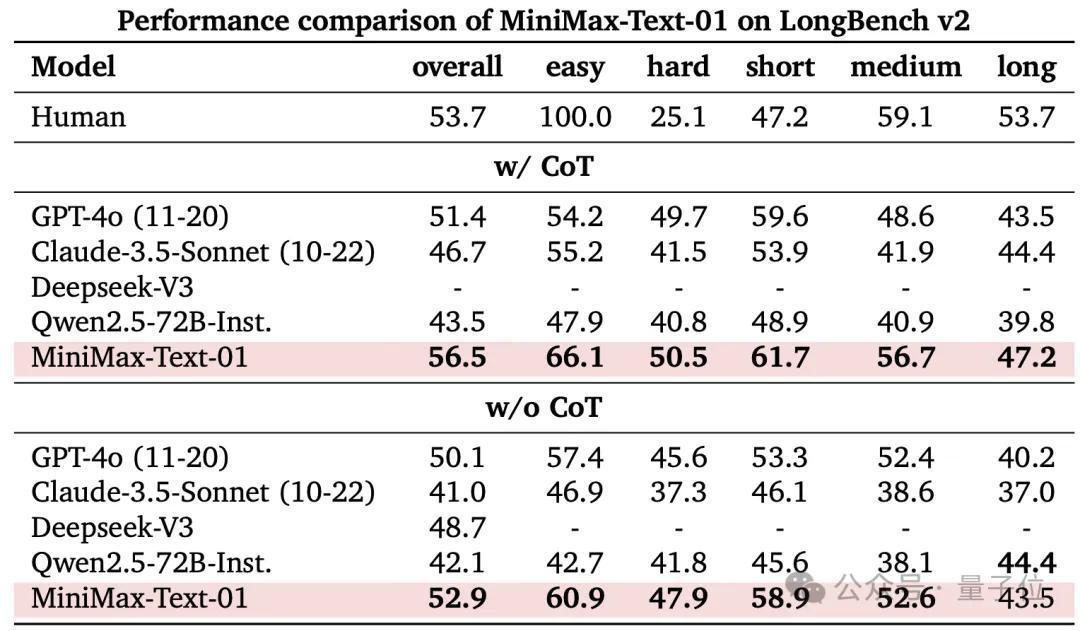

除此以外,还有LongBench v2、Ruler基准测试,进修的是模子长高下文长入智商,包含基于长高下文输入的逻辑推贤慧商。

MiniMax-Text-01模子在措置Ruler的长高下文推理任务时进展出显赫的上风。

在64K输入级别的进展与顶尖模子GPT-4o、Claude-3.5-Sonnet等竞争力畸形,变化轻细,但从128K入手显露出昭彰的上风,并卓越了通盘基准模子。

LongBench-V2包括不同难度级别的问答任务,涵盖多种高下文类型,包括单文档和多文档、多轮对话、代码仓库和长结构化数据等。团队计议了两种测试样式:不使用念念维链推理(w/o CoT)和使用念念维链推理(w/ CoT)。

MiniMax-Text-01在w/ CoT开导中终澄清通盘评估系统中的最好效果,在w/o CoT中进展也很显赫。

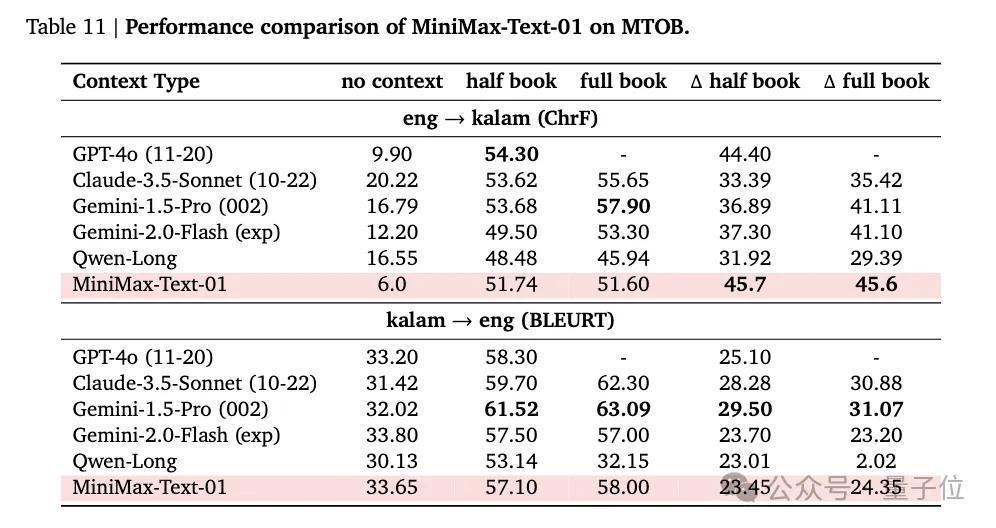

团队还用MTOB( Machine Translation from One Book)数据集评估了模子从高下文中学习的智商。

该任务条目模子在英语和Kalamang(一种在公开数据中相称有限的话语)之间进行翻译,因此在造就语料库中,LLM仅从一部语法书的部天职容和375个翻译示例中学习该话语。

测试效果骄傲,MiniMax-Text-01在无高下文场景下eng→kalam (ChrF)得分最低,团队觉得其它模子可能是在预造就或后造就数据中集加入了kalam干整个据。在delta half book和full book上,MiniMax-Text-01跳跃了通盘模子。

在kalam→eng(BLEURT)得分上MiniMax-Text-01也与其它模子进展畸形。

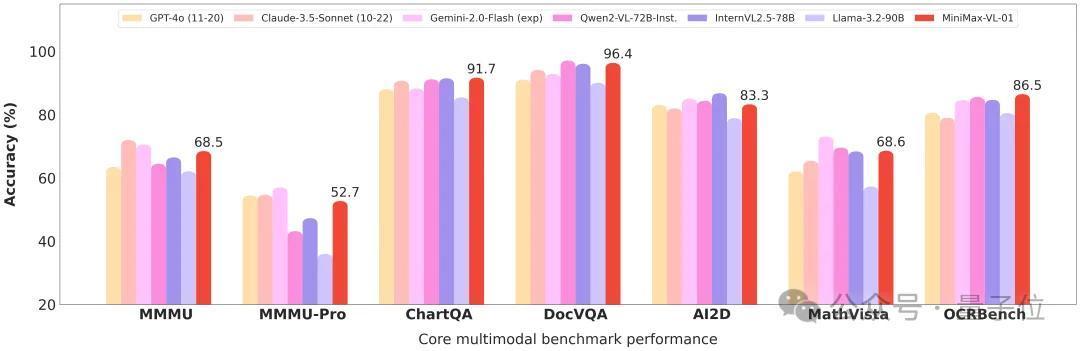

MiniMax-VL-01

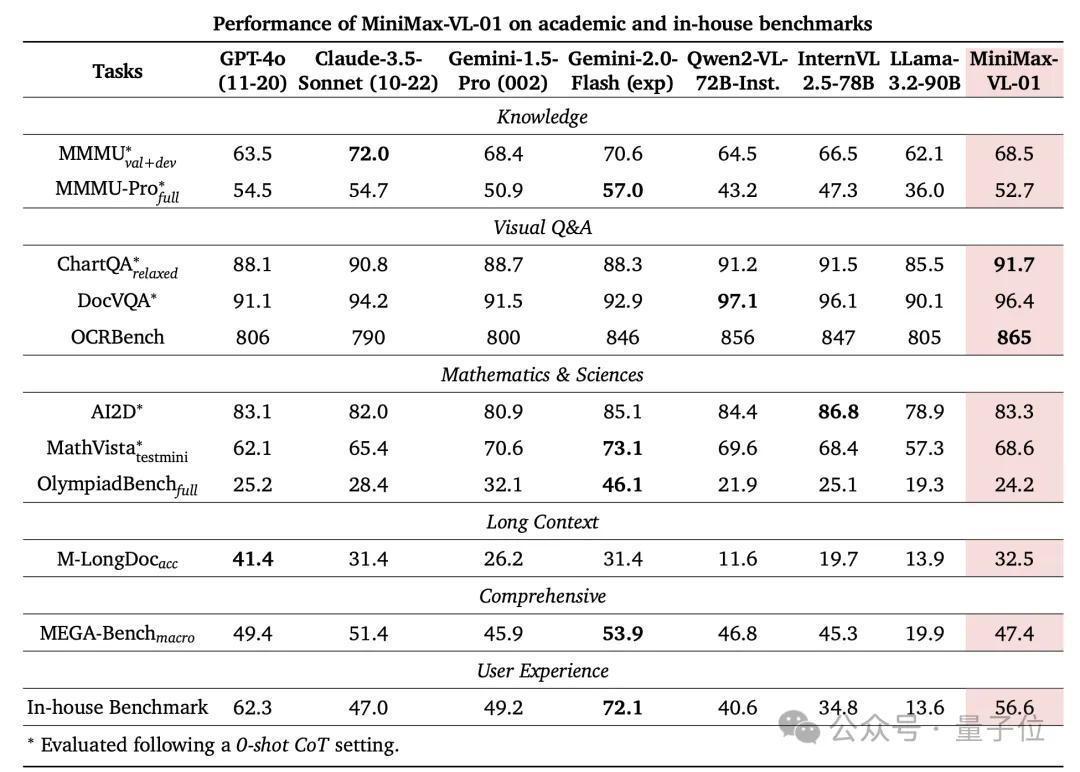

MiniMax-VL-01罗致多模态诳言语模子常用的“ViT-MLP-LLM”框架:

一个具有3.03亿参数的ViT用于视觉编码一个立时开动化的双层MLP projector用于图像适配以及算作基础LLM的MiniMax-Text-01MiniMax-VL-01非凡具有动态分辨率功能,不错笔据预设网作风整输入图像的大小,分辨率从336×336到2016×2016不等,并保留一个336×336的缩略图。

调整后的图像被分割成大小沟通的不一样块,这些块和缩略图诀别编码后组合,变成完满的图像默示。

MiniMax-VL-01的造就数据涵盖标题、形容和领导。ViT从新入手在6.94亿图像-标题对上进行造就。在造就历程的四个阶段,措置了合计5120亿token。

最终,MiniMax-VL-01 在多模态排名榜上进展隆起,讲授了其在措置复杂多模态任务中的上风和可靠性。

网友们已入手第一波实测

得知新模子已在Hailuo AI上部署,网友们已紧忙赶往测试。

有网友使用沟通的prompt将它和Gemini、o1对比,讴歌MiniMax-01进展令东谈主印象深远。

底下这个测试也没能难倒它:

给我5个奇数,这些数的英文拼写中不包含字母“e”。

感好奇瞻仰好奇瞻仰的童鞋不错玩起来了。

时刻论文:https://filecdn.minimax.chat/_Arxiv_MiniMax_01_Report.pdf

参考贯穿:[1]https://x.com/MiniMax__AI/status/1879226391352549451[2]https://huggingface.co/MiniMaxAI/MiniMax-Text-01[3]https://huggingface.co/MiniMaxAI/MiniMax-VL-01

— 完 —

量子位 QbitAI · 头条号签约

热枕咱们,第一时间获知前沿科技动态